OpenClaw: Bereitstellung, Konfiguration und Einsatz einer KI-Agentenplattform für skalierbare Automatisierung

Was ist OpenClaw und warum ist es für die KI-gestützte Entwicklung so relevant?

Falls Sie den neuesten Trend in der Entwicklung künstlicher Intelligenz verpasst haben: OpenClaw hat in den vergangenen Monaten stark an Popularität gewonnen. Es handelt sich um ein Open-Source-Tool zur einfachen und nahtlosen Entwicklung von Multi-Agenten-Systemen, das auch technisch unerfahrenen Anwendern ermöglicht, vollständige, stabile und zuverlässige KI-Agenten zu erstellen. Der Erfolg des Tools war so groß, dass das GitHub-Repository inzwischen zu den populärsten plattformübergreifend zählt und sogar das Linux-Kernel-Repository übertroffen hat, was für ein so junges Projekt außergewöhnlich ist.

OpenClaw ist ein agentenbasiertes Framework für die Softwareentwicklung, das insbesondere für Personen ohne tiefe technische Vorkenntnisse erhebliche Vorteile bietet, da sich die Plattform fast vollständig über natürliche Sprache konfigurieren lässt. Nutzer reden mit einem integrierten, ChatGPT-ähnlichen Chat, der Eingaben versteht und die gesamte Einrichtung per Konversation übernimmt. Genau hier liegt die größte Stärke von OpenClaw: Die Konfiguration und Programmierung erfolgt über natürliche Sprache, während die Leistung mit individuell entwickelten KI-Agenten vergleichbar bleibt.

Außerdem kann OpenClaw direkt mit Telegram- oder Discord-Bots sowie mit WhatsApp-Nummern verbunden werden. Dadurch ist die Plattform äußerst vielseitig und lässt sich in unterschiedlichsten beruflichen oder privaten Projekten flexibel einsetzen.

Kernkonzepte hinter OpenClaw

OpenClaw basiert auf einigen wichtigen Grundprinzipien. Es besteht aus vier Hauptkomponenten: Agenten, Tools, Aufgaben und Speicher. In dieser Architektur ist der Agent der funktionale Bestandteil, der mit dem Nutzer interagiert und alle Prozesse koordiniert. Dabei funktioniert der Agent jedoch nicht eigenständig, sondern aktiviert stets Tools, also ausführbare Schnittstellen, die mit APIs, Datenbanken, Skripten und anderen Systemen verbunden sind. Zu seinen Aufgaben gehören aktuell laufenden Prozesse, also konkrete Aktionen, die der Agent gerade ausführt. Der Speicher wiederum umfasst den Kontext und die Aufmerksamkeitsspanne, die ein Agent erfassen und behalten kann. Zusätzlich unterstützt der Speicher die erneute Verarbeitung von Informationen, verbessert Entscheidungsprozesse und sorgt für präzisere Entscheidungen.

Darin liegt der wesentliche Unterschied zwischen OpenClaw und einem klassischen Bash-Skript, das mit einem LLM verbunden ist, oder auch anderen Frameworks wie LangGraph. OpenClaw analysiert Eingaben auf einer höheren Ebene, versteht, welche Werkzeuge erforderlich sind und wie sie eingesetzt werden müssen. Zudem kann es mit einer Vielzahl unterschiedlicher Lösungen, MCPs, APIs, Datenbanken oder sogar eigenen Skripten verbunden werden, um spezifische Ziele zu erreichen. Die Möglichkeiten sind dabei fast unbegrenzt, da OpenClaw eine äußerst ganzheitliche und autonome Lösung ist und damit fast perfekt für universelle Automatisierungsszenarien mit KI-Agenten geeignet ist.

So funktioniert OpenClaw:

- Eingabe wird empfangen

- Der Agent interpretiert den Zweck

- Der Agent entscheidet: Wird ein Tool benötigt?

- Das Tool wird ausgeführt (API, Datenbank, Skript)

- Ergebnisse werden an den Agenten zurückgegeben

- Der Agent bewertet: Abschließen oder fortfahren?

- Endausgabe

Genau dieses Prinzip macht OpenClaw zu einer besonders attraktiven Lösung für Entwickler, Geschäftsführer oder auch für Personen ohne tiefgehende Kenntnisse in der Programmierung, die dennoch großes Interesse an Automatisierung und KI-Technologien haben.

Voraussetzungen für den Betrieb von OpenClaw

Um mithilfe von OpenClaw eigene KI-gestützte Workflows sowie LLM-Orchestrierungen zu erstellen, muss zunächst eine passende KI-Lösung ausgewählt werden. Viele Entwickler setzen auf Claude oder ChatGPT, da diese ohne Zweifel zu den leistungsfähigsten, aber auch kostenintensivsten Optionen gehören und nahezu alle Anforderungen abdecken. Preisgünstigere Alternativen sind beispielsweise Kimi, Mistral oder verschiedene über OpenRouter verfügbare Modelle. Auch wenn diese Modelle etwas weniger leistungsstark sind, decken sie dennoch über 90 % der typischen Anwendungsfälle ab, sofern keine außergewöhnlich hohen Rechenressourcen erforderlich sind. Für alltägliche Aufgaben reichen sie in den meisten Fällen vollkommen aus.

Wer OpenClaw für einfache Testprojekte nutzen möchte, braucht außerdem eine dedizierte Maschine oder einen VPS für das Hosting. Der Grund dafür liegt darin, dass der Betrieb in einer vollständig lokalen Bare-Metal-Umgebung erhebliche Risiken birgt, da OpenClaw potenziell auf kritische Systemeinstellungen und sensible Daten zugreifen kann. Falls ein lokaler Einsatz dennoch notwendig ist, empfiehlt sich dringend die Verwendung über Docker oder idealerweise auf einem separaten System.

Abschließend wird noch ein Kommunikationskanal benötigt. Am häufigsten kommen hierfür Telegram- oder Discord-Bots zum Einsatz. Beide lassen sich unkompliziert erstellen und verwalten. In der Regel genügt es, den Bot einzurichten, ein Token zu generieren und dieses in die OpenClaw-Konfiguration einzutragen. Die weitere Einrichtung erfolgt automatisch.

Schritt-für-Schritt-Anleitung für OpenClaw: Installation und Bereitstellung

Konfiguration der Docker-Compose-Datei

Wie oben erklärt, verwenden wir Docker, um unsere Umgebung zu containerisieren und sie vom restlichen System zu isolieren. Da OpenClaw vollständig autonom ohne menschlichen Eingriff funktioniert, besteht die Möglichkeit, dass es früher oder später Systemeinstellungen oder persönliche Dateien verändert. Um dieses Risiko zu vermeiden, empfiehlt sich der Einsatz von Docker als Schutzmaßnahme.

Dafür muss zunächst ein Ordner erstellt werden, in dem die OpenClaw-Dateien gespeichert werden. Anschließend wird darin eine Datei mit dem Namen „compose.yaml“ angelegt, die folgenden Inhalt enthält:

services:

openclaw:

container_name: openclaw

image: ghcr.io/openclaw/openclaw:latest

ports:

- "18789:18789"

environment:

OPENAI_API_KEY: ${OPENAI_API_KEY}

ANTHROPIC_API_KEY: ${ANTHROPIC_API_KEY}

OPENROUTER_API_KEY: ${OPENROUTER_API_KEY}

command: ["node", "openclaw.mjs", "gateway", "--allow-unconfigured", "--bind", "lan"]

restart: unless-stoppedAchten Sie besonders genau auf die verwendeten Abstände. YAML-Dateien folgen einer strikten Hierarchie, und sogar kleine Formatierungsfehler können dazu führen, dass sie nicht funktionieren.

Wie definieren hier drei Umgebungsvariablen, die als API-Schlüssel für unsere KI-Modelle dienen. Um diese Variablen mit Ihren tatsächlichen Werten zu hinterlegen, müssen Sie im selben Ordner eine „.env“-Datei mit Ihrer Schlüssel erstellen, beispielsweise in folgender Form:

OPENAI_API_KEY=""

OPENROUTER_API_KEY=""

ANTHROPIC_API_KEY=""Tragen Sie nur die Werte ein, die Sie tatsächlich verwenden möchten. Diese werden anschließend automatisch in die von Docker Compose erstellte Umgebung eingebunden.

Einsatz mit Docker

Nachdem beide Dateien erstellt wurden, kann das Projekt mithilfe von Docker auf Basis der in der „compose.yaml“-Datei definierten Images aufgebaut werden. Führen Sie im Terminal innerhalb des zuvor angelegten OpenClaw-Verzeichnisses folgenden Befehl aus:

docker compose up -d --buildFalls Sie mit der Funktionsweise nicht vollständig vertraut sind, hier eine kurze Zusammenfassung:

Docker ist ein System zur Erstellung von Containern auf Ihrem Computer. Diese Container dienen dazu, Anwendungen, Services oder Server in einer isolierten Umgebung auszuführen. Sie laufen zwar auf Ihrem System, bleiben jedoch von Ihren persönlichen Prozessen getrennt und haben keinen direkten Zugriff auf Ihre privaten Daten. Gerade für die Bereitstellung von OpenClaw ist dies sehr vorteilhaft, da Ihre Daten auch bei einer lokalen Installation geschützt bleiben.

Docker verwendet Dateien wie Dockerfile und „compose.yaml“. Das Dockerfile definiert, wie aus einer Software eine Docker-Image erstellt wird. Im Fall von OpenClaw enthält der Quellcode ein entsprechendes Dockerfile, das den Build-Prozess beschreibt. Die „compose.yaml“-Datei bestimmt, wie verschiedene Images gemeinsam orchestriert werden, miteinander und mit externen Systemen interagieren, um eine vollständige Infrastruktur aufzubauen.

Ein typisches Beispiel wäre eine Full-Stack-Webanwendung mit Backend, Frontend und Datenbank. Jede dieser Komponenten benötigt ihr eigenes Dockerfile, während die „compose.yaml“ regelt, wie alle Container gemeinsam gestartet und verbunden werden. Dadurch lässt sich die gesamte Umgebung mit wenigen Befehlen steuern, beispielsweise mit dem zuvor genannten „docker compose up -d –build“, das alle definierten Dienste erstellt und startet.

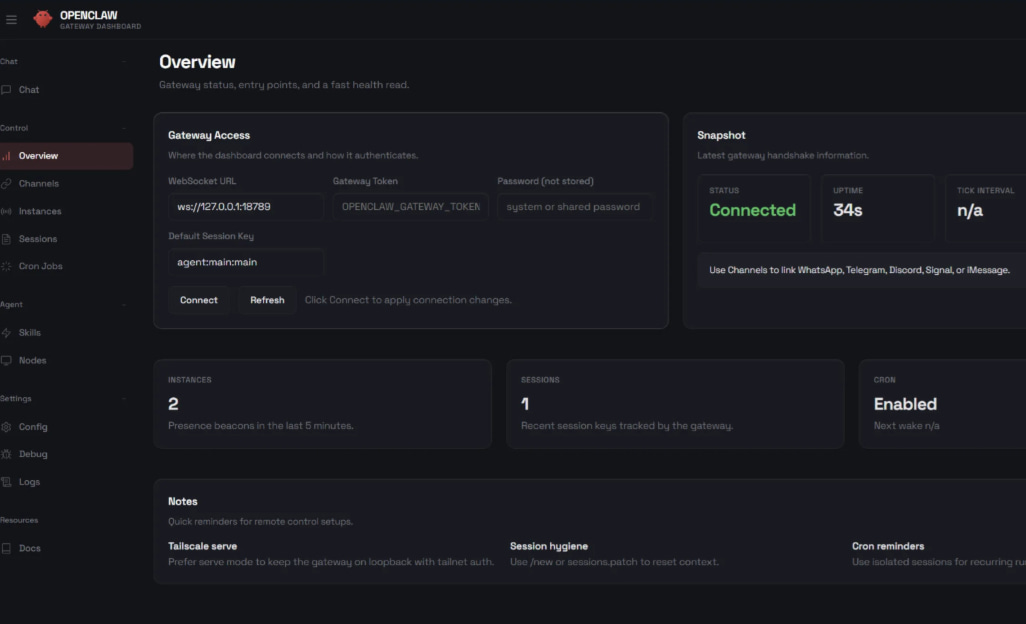

Lokaler Zugriff und Interaktion

Sobald die Docker-Images erstellt und die Anwendung aktiviert wurde, können Sie OpenClaw lokal unter http://localhost:18789 aufrufen.

Wichtig ist dabei, dass Sie das verwendete KI-Modell über die Befehle „/models“ und „/model“ steuern können:

- „/models“ zeigt alle verfügbaren Modelle an und ermöglicht zudem die Sortierung nach Anbietern wie OpenAI, OpenRouter oder Kimi.

- „/model“ dient zur Auswahl eines konkreten Modells.

Die Benutzeroberfläche ermöglicht einen direkten Zugriff auf das Modell und eine flexible Anpassung der Konfiguration.

Falls Sie jedoch einen anderen Anbieter nutzen möchten, der nicht in der „compose.yaml“ eingetragen ist, müssen Sie dessen API-Schlüssel zunächst in die Umgebungsvariablen aufnehmen und anschließend den Container neu starten.

So nutzen Sie OpenClaw mit minimalen Kosten

Die günstigsten KI-Modelle

Wie Sie vermutlich wissen, können die Kosten für den Betrieb von OpenClaw schnell stark ansteigen. Jede API-Anfrage verbraucht mindestens etwa 10.000 Tokens, was sich äußerst schnell summiert und deutlich höhere Kosten verursachen kann als ursprünglich erwartet. Um dies zu vermeiden, lässt sich auf deutlich günstigere Alternativen zurückgreifen. Dies gilt insbesondere dann, wenn Sie nicht zwingend auf die besonders kostenintensiven Reasoning-Modelle von OpenAI oder Anthropic angewiesen sind. Diese Alternativen liefern in vielen Fällen fast vergleichbare Ergebnisse.

Dazu gehören unter anderem:

- Kimi K2 (Moonshot AI): 0,60 US-Dollar pro Million Eingabe-Tokens und 2,50 US-Dollar pro Million Ausgabe-Tokens

- Qwen Turbo (Alibaba): 0,05 US-Dollar pro Million Eingabe-Tokens und 0,20 US-Dollar pro Million Ausgabe-Tokens

- Qwen 3.5 Plus (Alibaba): 0,26 US-Dollar pro Million Eingabe-Tokens und 1,56 US-Dollar pro Million Ausgabe-Tokens

- DeepSeek V3.2 (DeepSeek): 0,14 US-Dollar pro Million Eingabe-Tokens und 0,28 US-Dollar pro Million Ausgabe-Tokens. Anmerkung zu DeepSeek: Obwohl dieses Modell oft das beste Preis-Leistungs-Angebot im günstigen Segment darstellt, hat es zum Zeitpunkt der letzten Überprüfung nicht zuverlässig mit OpenClaw funktioniert. Im GitHub-Repository bestand hierzu ein offenes Problem, dessen aktueller Status und langfristige Verlässlichkeit jedoch unklar bleiben.

- Auch OpenRouter stellt eine sehr attraktive Option dar. Da OpenRouter als Vermittler für verschiedene KI-Modelle fungiert, variieren die Preise je nach gewähltem Modell und bieten meist ein sehr gutes Preisniveau.

Wie Sie OpenClaw kostenlos oder fast kostenlos betreiben

Es gibt weitere Möglichkeiten, um die Kosten noch mehr zu reduzieren.

Beispielsweise kann man ein Sprachmodell Qwen 3.5 9B oder vergleichbare Modelle über Ollama lokal ausführen. Dies kann entweder auf einem leistungsstarken eigenen System erfolgen, idealerweise mit mindestens 16 GB RAM und vorzugsweise dedizierter GPU, oder alternativ auf einem Mac Mini. Viele Mac-Mini-Systeme verfügen über leistungsfähige integrierte Grafiklösungen oder sogar spezialisierte NPUs, wodurch sie KI-Modelle effizient ausführen und auch komplexere Reasoning-Prozesse unterstützen können.

Eine weitere Möglichkeit besteht in der Nutzung kostenloser Anbieter wie OpenRouter oder OpenCode. OpenCode stellt eine Auswahl vollständig kostenloser KI-Modelle bereit, ist jedoch begrenzt:

- Am ersten Tag sind bis zu 50 API-Anfragen möglich

- Nach 24 Stunden wird das Limit auf 10 Anfragen pro Tag zurückgesetzt

- Mit einer Einzahlung von 10 US-Dollar erhöht sich das tägliche Limit auf bis zu 100 Anfragen bei kostenlosen Modellen

Dadurch bleiben Ihre Guthabenreserven weitgehend erhalten, während Sie dennoch erweiterte Nutzungsmöglichkeiten erhalten.

Allerdings geht die starke Kostenersparnis häufig mit qualitativen Einschränkungen einher. Bei günstigeren oder kostenlosen Modellen treten Halluzinationen häufiger auf und sind bei komplexen Entwicklungsaufgaben im Softwarebereich oft weniger zuverlässig.

Fazit: Wann OpenClaw produktiv eingesetzt werden sollte

OpenClaw ist ein leistungsfähiges, zugleich jedoch potenziell riskantes Werkzeug zur Entwicklung vollständig autonomer KI-Agenten. Nicht ohne Grund bezeichnet sich das Projekt selbst als „Die KI, die wirklich etwas bewirkt“. Mit nur einem einzelnen Prompt, beispielsweise über Telegram oder Discord, kann OpenClaw komplexe Prozesse, Automatisierungen und ganze Workflows ausführen. Die Einsatzmöglichkeiten sind enorm vielfältig, doch genau darin liegt auch das Risiko. Bei unsachgemäßer Konfiguration oder übermäßig weitreichenden Berechtigungen kann OpenClaw:

- persönliche Daten löschen

- kritische Systemdateien verändern

- unerwünschte Nachrichten oder E-Mails über persönliche Konten versenden

- sensible Systemeinstellungen manipulieren

Daher gilt auch hier: Große Leistungsfähigkeit erfordert besondere Vorsicht. OpenClaw sollte ausschließlich mit klar definierten Sicherheitsmaßnahmen, kontrollierten Berechtigungen und einer gut geplanten Infrastruktur eingesetzt werden. Wer das Potenzial verantwortungsvoll nutzt, erhält jedoch eine außergewöhnlich leistungsstarke Plattform für KI-gestützte Automatisierung.